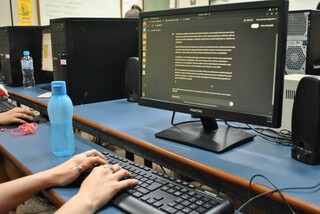

Universidades passam a exigir transparência no uso de IA em trabalhos

Regras incluem obrigação de informar ferramentas usadas e punição em casos de fraude acadêmica

As duas principais universidades públicas já começaram a colocar limites claros para o uso de inteligência artificial por alunos e professores. Enquanto a UEMS (Universidade Estadual de Mato Grosso do Sul) aposta em orientação e acompanhamento institucional, a UFMS (Universidade Federal de Mato Grosso do Sul) avançou um passo além e já prevê sanções disciplinares em caso de uso indevido.

RESUMO

Nossa ferramenta de IA resume a notícia para você!

Na UEMS, o tema ainda está em fase de estruturação, mas já há um guia oficial que orienta o uso ético e responsável da tecnologia. Em resposta ao Campo Grande News, a universidade afirma que acompanha “de forma atenta e responsável o avanço do uso de ferramentas de inteligência artificial generativa no ambiente acadêmico”.

- Leia Também

- Usando IA, sertanejos lançam clipe em homenagem a João Carreiro

- Residência em software da UFMS com bolsa de R$ 5 mil atrai 446 inscritos

A instituição reforça que a ferramenta não substitui o trabalho intelectual. Segundo a universidade, o uso deve ocorrer “com responsabilidade, transparência e supervisão humana”, sem abrir mão da autoria, da veracidade e da integridade acadêmica.

Além disso, a UEMS criou, em 2025, um Comitê de Inteligência Artificial para formular políticas e diretrizes internas. O movimento, segundo a própria universidade, busca alinhar “inovação tecnológica, integridade acadêmica e responsabilidade institucional”.

Já na UFMS, as regras estão formalizadas em uma política institucional publicada no fim de 2025. O documento estabelece que o uso da tecnologia deve seguir critérios claros e, em muitos casos, depender da orientação do professor.

De acordo com a universidade, “o uso de ferramentas de Inteligência Artificial pelos estudantes deve ocorrer de forma ética, responsável e transparente”, respeitando as orientações docentes e as regras das disciplinas.

Quando não houver instrução específica, o aluno pode usar a tecnologia apenas como apoio, mas precisa deixar isso explícito. A norma prevê que o estudante deve “utilizar as ferramentas somente como apoio, declarando seu uso, quando aplicável, e avaliar criticamente os resultados obtidos”.

A política também detalha como a IA (inteligência artificial) pode ser usada em pesquisas, como em análise de dados, revisão de textos e levantamento de referências, desde que com transparência. Em artigos e relatórios, por exemplo, passa a ser obrigatório informar os métodos, ferramentas e versões utilizadas.

Outro ponto é a autoria. A UFMS deixa claro que ferramentas de IA “não configuram autoria e não devem constar na lista de autores”, devendo ser apenas mencionadas no processo de produção.

O documento ainda estabelece limites para uso de imagem e voz geradas por IA, que só podem ser utilizadas com consentimento da pessoa retratada e com indicação de que houve manipulação tecnológica.

Nos casos de uso indevido, a consequência é direta. A universidade prevê que situações que configurem fraude ou violação da integridade acadêmica devem sofrer sanção disciplinar, conforme as normas internas.

Além da regulamentação, a UFMS passou a incluir, a partir de 2026, uma disciplina sobre inteligência artificial nos cursos de graduação, com temas que vão de conceitos básicos até ética, privacidade e impactos sociais da tecnologia.

Receba as principais notícias do Estado pelo Whats. Clique aqui para acessar o canal do Campo Grande News e siga nossas redes sociais.